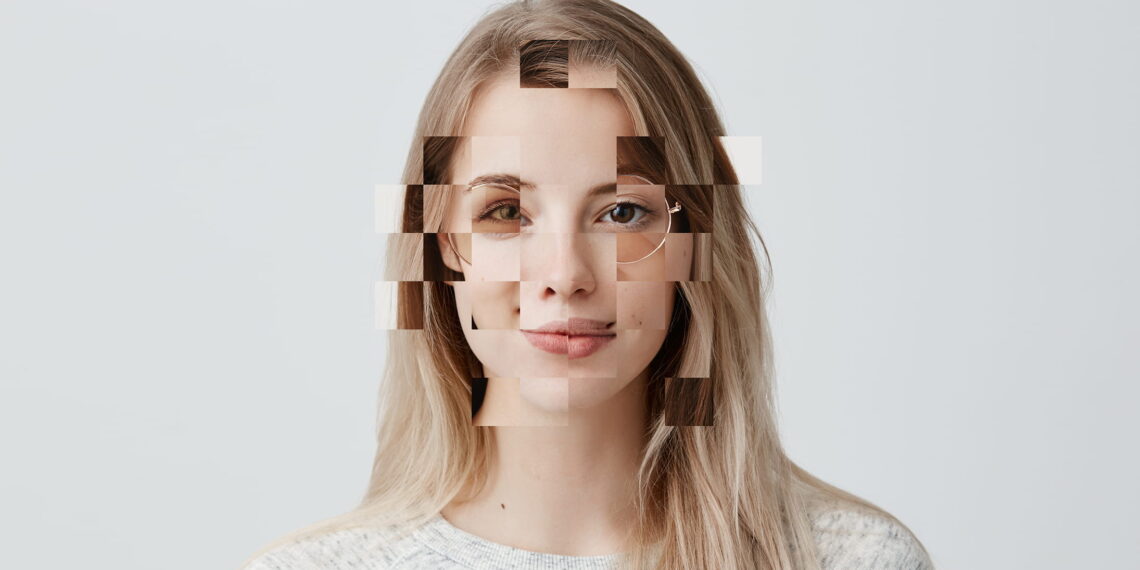

Deepfakes são vídeos, imagens ou áudios manipulados com recurso a inteligência artificial, em particular a técnicas de deep learning, para substituir o rosto ou a voz de uma pessoa por outra de forma convincente. O nome resulta da fusão de deep learning com fake — e a combinação não podia ser mais perturbadora.

O que era, há cinco anos, uma curiosidade tecnológica reservada a investigadores e entusiastas, tornou-se hoje uma ameaça concreta à desinformação, à privacidade e até à democracia.

Em Portugal, tal como no resto do mundo, os casos multiplicam-se: desde vídeos falsos de figuras públicas a fazer declarações que nunca fizeram, até conteúdos pornográficos não consensuais com rostos de pessoas reais.

Como funciona a tecnologia por detrás dos deepfakes

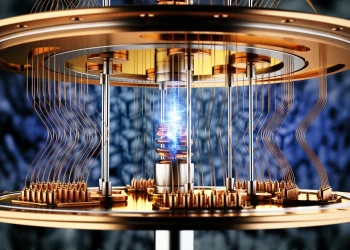

A base tecnológica dos deepfakes assenta em redes neuronais generativas adversariais, conhecidas como GANs (Generative Adversarial Networks). Estas redes funcionam com dois componentes em competição: um gerador, que cria conteúdo falso, e um discriminador, que tenta detetar se o conteúdo é real ou falso. Quanto mais treinam, mais convincente fica o resultado.

Ferramentas como o DeepFaceLab, o FaceSwap ou, mais recentemente, soluções comerciais baseadas em modelos de difusão, permitiram democratizar esta tecnologia a um ponto preocupante. Hoje, qualquer pessoa com um computador razoável e paciência suficiente consegue criar um deepfake credível em poucas horas.

Os sinais que traem um vídeo falso

Mesmo os deepfakes mais sofisticados deixam pistas. Saber onde olhar é meio caminho andado para não ser enganado.

- Olhos e piscar de olhos: Durante muito tempo, os modelos de IA tinham dificuldade em replicar o piscar natural dos olhos. Vídeos com ritmo de pestanejar irregular ou olhos com brilho artificial são um sinal de alerta.

- Contornos do rosto e cabelo: A zona de transição entre o rosto e o cabelo, as orelhas ou o pescoço é frequentemente o ponto mais fraco de um deepfake. Procure bordas esbatidas, artefatos ou inconsistências de iluminação nessas áreas.

- Sincronização labial: Quando o áudio e o movimento dos lábios não coincidem de forma natural, especialmente em consoantes e vogais mais abertas, isso é um forte indicador de manipulação.

- Expressões faciais pouco naturais: Micro-expressões como um sorriso que não chega aos olhos, ou uma sobrancelha que se move de forma assimétrica, são difíceis de replicar com perfeição.

- Textura da pele e iluminação: Pele demasiado suave, sem poros visíveis, ou com iluminação inconsistente face ao ambiente do vídeo são marcas frequentes.

- Artefatos em movimento rápido: Quando a pessoa vira a cabeça rapidamente ou o vídeo tem movimentos bruscos, os algoritmos têm mais dificuldade em manter a coerência do rosto sintético.

Ferramentas para detetar deepfakes automaticamente

A boa notícia é que a mesma IA que cria deepfakes está também a ser usada para os detetar. Existem já várias ferramentas disponíveis, algumas gratuitas, que qualquer pessoa pode usar.

O Microsoft Video Authenticator analisa vídeos e imagens em busca de sinais de manipulação, atribuindo uma pontuação de confiança. O Deepware Scanner é uma solução online gratuita que permite submeter vídeos para análise automática.

A startup portuguesa Unbabel e outros projetos europeus inseridos no programa Horizon da Comissão Europeia também trabalham nesta área da deteção de desinformação multimédia.

O projeto FakeCatcher da Intel é particularmente interessante: em vez de analisar artefatos visuais, deteta a ausência de fluxo sanguíneo subtil no rosto — algo presente em rostos reais mas ausente em faces geradas por IA. A precisão declarada supera os 96%.

O contexto em Portugal e na Europa

Na Europa, a resposta regulatória está a avançar. O AI Act, aprovado pelo Parlamento Europeu em 2024, obriga à identificação clara de conteúdos gerados por IA, incluindo deepfakes.

Em Portugal, a ANACOM e a Entidade Reguladora para a Comunicação Social (ERC) têm acompanhado o fenómeno, mas a regulação ainda está longe de ser suficientemente ágil face à velocidade da tecnologia.

Casos como o vídeo falso do antigo Presidente Marcelo Rebelo de Sousa alegadamente a promover um esquema de investimento, circulado em 2023 nas redes sociais, mostram que Portugal não está imune. Esse tipo de conteúdo não serve apenas para enganar — serve para minar a confiança nas instituições e nas próprias figuras públicas.

O que fazer se encontrar um deepfake

Se suspeitar de que um vídeo é falso, evite partilhá-lo antes de verificar a sua origem. Utilize ferramentas de verificação como a pesquisa inversa de imagem do Google ou do TinEye.

Consulte plataformas de fact-checking como o Polígrafo ou o Observador Fact Check, que operam em Portugal. E, se o conteúdo envolver uma pessoa real e puder causar dano, denuncie-o diretamente na plataforma onde o encontrou.

A literacia digital como primeira linha de defesa

A tecnologia de deteção vai sempre um passo atrás da de criação — é uma corrida armamentista digital sem fim à vista. Por isso, a melhor defesa continua a ser a literacia digital: questionar o que se vê, verificar as fontes e não partilhar conteúdo emotivo sem antes pensar.

Os deepfakes são, possivelmente, um dos maiores desafios à confiança na informação que esta geração vai enfrentar. Aprender a reconhecê-los não é paranoia — é uma competência essencial para navegar no ecossistema mediático do século XXI.

E em Portugal, onde ainda há muito caminho a percorrer na educação digital, este tema merece urgentemente mais atenção nas escolas, nos média e no debate público.